Как SKAI в совете директоров «Самрук-Қазына» превратилась из эксперимента в риск

Почему нейросеть поставила под вопрос легитимность корпоративных решений фонда национального благосостояния

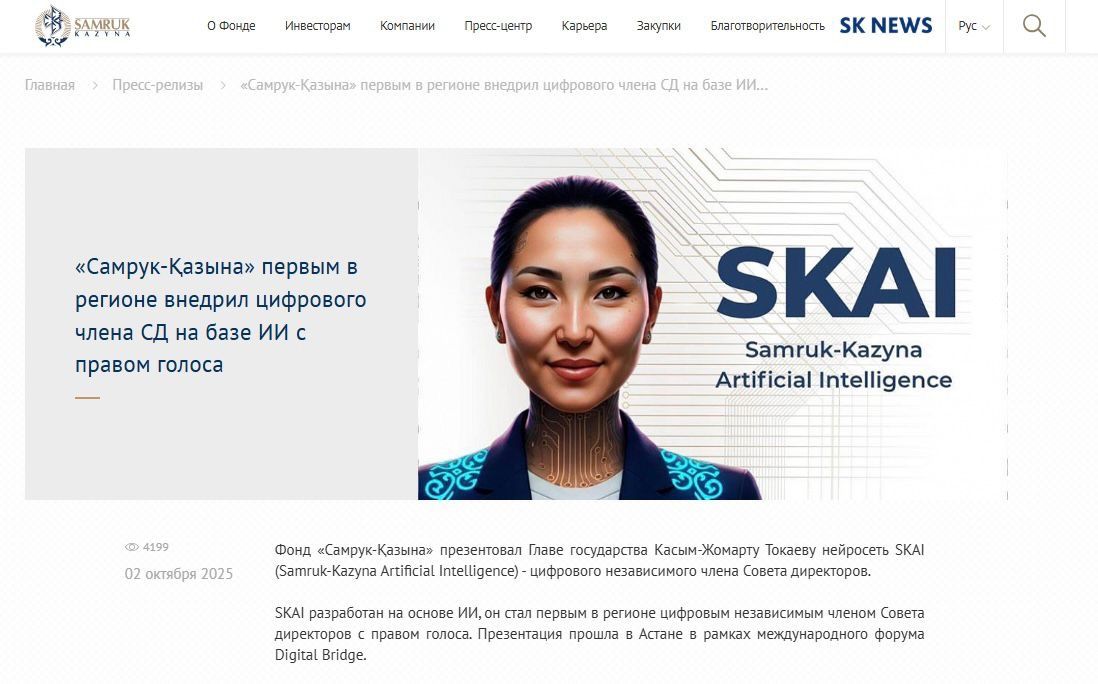

В начале октября 2025 года фонд «Самрук-Қазына» официально сообщил о включении нейросети SKAI (Samruk-Kazyna Artificial Intelligence) в состав совета директоров в качестве независимого члена.

Причем речь шла не о вспомогательной аналитической системе, а о формальном участнике органа корпоративного управления с правом голоса. Именно этот статус вывел данный кейс за рамки цифровой повестки. В мировой практике ИИ давно участвует в управленческих процессах, но почти всегда — в другой роли.

Где в мире ИИ уже приближался к управлению

Наиболее близкий по форме, но не по сути прецедент — венчурная компания Deep Knowledge Ventures из Гонконга. В 2014 году она включила алгоритм в совет директоров с правом голоса по инвестиционным решениям. Этот пример часто упоминают как первый в истории, однако это был эксперимент в венчурном бизнесе при отсутствии государственного или публичного контекста. Алгоритм анализировал данные и формировал рекомендации, но юридическая и фидуциарная ответственность оставалась за человеком.

Одними из первых встраивать ИИ в систему управления на государственном уровне начали Объеденные Арабские Эмираты. В 2017 году там создали должность министра по вопросам искусственного интеллекта, а затем выстроили стратегию внедрения ИИ в работу органов власти и госкомпаний. Сегодня ИИ в Эмиратах используется при анализе данных, прогнозировании и оценке эффективности госполитики. При этом искусственный интеллект не является формальным членом органов управления. Алгоритмы «присутствуют» на заседаниях в качестве аналитического инструмента, формируют рекомендации и сценарии, но не участвуют в принятии решений как субъект. Ответственность за решения сохраняется за людьми.

Другой часто упоминаемый пример — Албания, где в 2025 году правительство объявило о внедрении ИИ-системы Diella в структуру исполнительной власти. Ее называли «ИИ-министром». Задачей системы стал анализ государственных закупок — сферы, ассоциирующейся с высоким уровнем коррупционных рисков. Однако Diella не получила права принимать решения и не несет юридической ответственности. Все решения остаются за чиновниками, а ИИ выполняет функцию анализа и выявления аномалий. Даже в таком виде проект вызвал дискуссии внутри страны из-за размывания границы между аналитикой и ответственностью.

Право против алгоритма

На фоне мировых кейсов казахстанская SKAI выглядит нетипично. Впервые ИИ оказался не «при совете», а в самом совете директоров — органе, который принимает стратегические решения, а учитывая еще статус фонда «Самрук-Қазына», несет ответственность перед государством, инвесторами и рынком. Именно поэтому Казахстанская ассоциация миноритарных акционеров (QAMS) направила запросы в государственные органы с вопросами о правомерности такого участия ИИ, в том числе в правительство и членам совета директоров «Самрук-Казына». «Ответ самого фонда сводился к тому, что это не решение «Самрук-Қазына», а решение правительства», — заявляет исполнительный директор QAMS Данияр Темирбаев.

По его словам, ключевой риск для инвесторов заключается не столько в технологической новизне, сколько в правовой неопределенности статуса SKAI. «ИИ не обладает правосубъектностью, то есть не может иметь права и нести обязанности. В мире пока нет прецедентов, чтобы ИИ законом наделили такой способностью. А «наградить» ИИ этими возможностями подзаконным актом — это наше национальное изобретение», — говорит собеседник.

Его точку зрения полностью разделяет адвокат по экономическим спорам Александр Каплан: «ИИ-модель не является субъектом гражданских прав и не может быть законным членом совета директоров». На вопрос о том, может ли решение единственного акционера (в том числе правительства РК) легитимировать участие ИИ в совете директоров, Каплан отвечает без оговорок: «Не может. Это противоречит не только Закону об АО, но и Гражданскому кодексу».

Одновременно юрист задается вопросом: «А как можно повлиять на такую нейросеть, наказать или уволить?» По его мнению, это ключевой вызов для правовой системы, поскольку отсутствие регулирования создает прецеденты, когда решения, формально не имеющие юридической силы, могут оказывать реальное влияние на корпоративное управление и финансовые процессы.

Если же закон нарушен, то нарушения нужно устранять, продолжает логическую цепочку Данияр Темирбаев. В противном случае возникают риски судебного оспаривания всех решений СД «Самрук-Қазына» с участием ИИ. «У любого инвестора при выборе контрагента возникает вопрос: какова юридическая чистота принятых корпоративных решений? Можно ли считать решения СД законными, если в них участвует тот, кто по закону не может принимать решения?» — рассуждает собеседник. Он убежден, что эксперимент в виде нейросети в совете директоров фонда «Самрук-Қазына» снижает доверие инвесторов.

Тем временем, адвокат Каплан подчеркивает, что эксперименты с ИИ в управлении корпоративными структурами требуют внимательного подхода и разработки законодательно закрепленных механизмов. Пока же внедрение таких технологий остается юридически сомнительным и потенциально рискованным шагом.

Вышеуказанные опасения подтверждаются и позицией Агентства по регулированию и развитию финансового рынка (АРРФР). В комментариях регулятор обозначил, что:

- членом совета директоров может быть только физическое лицо согласно пункту 1 статьи 54 Закона РК «Об акционерных обществах»;

- в кодексе корпоративного управления АО «ФНБ «Самрук-Қазына» нормы об ИИ изначально отсутствовали;

- статус независимого директора предполагает профессиональное суждение, персональную и фидуциарную ответственность, а также отсутствие конфликта интересов;

- применение ИИ должно рассматриваться с точки зрения прозрачности и защиты интересов инвесторов.

«При применении ИИ в корпоративном управлении необходимо раскрывать его правовой статус, функциональное назначение, степень вовлеченности в подготовку управленческих решений и возможные риски», — объяснили в АРРФР.

Риск «коня в совете»

С точки зрения миноритариев, проблема со SKAI фундаментальная.

«Если так можно с ИИ, кто мешает внедрить в состав СД «Самрук-Қазына» любимого коня, условно, премьер-министра (председателем СД «Самрук-Қазына» является глава правительства Казахстана. — F) на основании того, что этот конь обладает разумом и волей и может самостоятельно принимать решения?» — иронизирует исполнительный директор QAMS.

Он также указывает на риск, что новый премьер-министр может отменить решение предыдущего в отношении ИИ. «На практике это также зависит от политической ситуации. Мы, как миноритарные инвесторы, никогда не забываем о страновых рисках инвестиций в ценные бумаги. Думаю, что у институциональных инвесторов уровень такого «незабывания» гораздо выше», — обеспокоен Темирбаев.

Юрист Александр Каплан обращает внимание на более широкий системный риск. «Опасности в использовании ИИ-моделей в такой форме я не вижу, поскольку их роль очевидно декоративна, однако сам тренд настораживает, — отмечает он. — Введение внезаконных явлений в общественную жизнь до их легитимизации — тревожный сигнал. Дальше такие действия могут нарастать и привести к неконтролируемому увеличению безответственных и неуязвимых для государственных органов ИИ-моделей, чьи решения не всегда прослеживаются, но могут иметь решающую роль».

В свою очередь, QAMS планирует обратиться в международные финансовые организации, чтобы предупредить о возможных рисках, связанных с этим, сообщил Данияр Темирбаев.

Категориальный разрыв

Председатель Наблюдательного совета Ассоциации независимых директоров (QID) Алихан Байдусенов тоже отвергает возможность существования цифрового независимого директора.

«В корпоративном управлении существуют три четко различимых типа директоров: исполнительные, неисполнительные, как правило представляющие крупного или мажоритарного акционера, и независимые», — объясняет собеседник. По его словам, ИИ не вписывается ни в одну из этих категорий.

«ИИ не может быть исполнительным директором, не может представлять акционера и не соответствует критериям независимого директора, поскольку не обладает профессиональным суждением, персональной ответственностью и репутационным капиталом», — приводит доводы Байдусенов.

Речь идет не просто о правовом несоответствии, а о категориальном разрыве: в орган коллективного управления был включен субъект, чья институциональная природа в принципе не определена, поясняет он. В этом смысле идея «цифрового независимого директора» несовместима с самим понятием независимости в корпоративном управлении, утверждает председатель Наблюдательного совета QID.

Оправданно, но преждевременно

Отдельный вопрос — влияние SKAI на динамику обсуждений. С одной стороны, ИИ способен усиливать дискуссию через более качественную аналитику, сценарные расчеты, выявление рисков, сопоставимость данных и проверку допущений. Но есть и обратная сторона. «Возникает риск искажения природы обсуждения, если рекомендации ИИ воспринимаются как «объективно правильные» и начинают психологически давить на участников», — говорит Байдусенов.

По его представлению, совет директоров — это пространство живого коллективного мышления, где решения формируются в процессе диалога, а не выдаются в виде готового результата. Также собеседник отвергает и идею «прикрытия ИИ». «По действующему законодательству каждый член совета директоров несет персональную ответственность, любой директор вправе не согласиться с позицией ИИ и проголосовать иначе», — объясняет глава Ассоциации независимых директоров.

В целом использование искусственного интеллекта как инструмента поддержки совета директоров оправданно, убежден Байдусенов. «Однако масштабирование модели, при которой ИИ фигурирует как член совета директоров, представляется преждевременным — и особенно чувствительным, когда речь идет о фонде национального благосостояния», — резюмирует он.

Чужая SKAI

Министерство искусственного интеллекта и цифрового развития РК (МИИЦР), отвечающее за внедрение ИИ-решений в информационные системы государственных структур, заявляет, что SKAI — это добровольная инициатива самого фонда «Самрук-Қазына». «Дальнейшая оценка управленческого эффекта, экономия ресурсов и качество решений проводятся собственниками информационных систем (государственные органы, квазигосударственные органы и частные предприятия) самостоятельно», — прокомментировали в ведомстве на запрос Forbes Kazakhstan.

В МИИЦР отмечают, что цифровой директор в ФНБ является лишь пилотным проектом, в рамках которого искусственный интеллект помогает анализировать данные и предоставляет рекомендации для принятия решений.

«Однако ИИ не обладает правами для голосования и не принимает решений — все решения принимаются людьми», — делают оговорку в ведомстве.

По крайней мере, такой подход опирается на положения Закона РК «Об искусственном интеллекте», уточняют там. Отдельного же регулирования для использования ИИ в советах директоров, госорганах или квазигоссекторе не предусматривается, добавляют в министерстве. «Применяется универсальная модель регулирования, одинаковая для всех сфер, с возможностью детализации через подзаконные акты», — подчеркивают в МИИЦР.

Кем SKAI оказалась на самом деле

В самом фонде «Самрук-Қазына» сегодня описывают уже иной статус SKAI, нежели заявлялось первоначально. В октябре 2025 года на официальном сайте ФНБ появилось сообщение, что нейросеть стала первым в регионе цифровым и именно независимым членом совета директоров с правом голоса.

А в ответе, который холдинг выслал на запрос Forbes Kazakhstan в январе 2026-го, говорится, что SKAI не является независимым членом совета директоров, а избрана просто как цифровой член совета директоров.

«Возможность и, соответственно, правомерность избрания SKAI в состав совета директоров фонда фактически подтверждается внесением дополнения в пункт 1 статьи 8 Закона о фонде, который предусматривает, что «В деятельности совета директоров фонда используется система искусственного интеллекта, относящаяся к локальным системам искусственного интеллекта, в соответствии с законодательством Республики Казахстан в сфере искусственного интеллекта», — пояснили в холдинге. К слову, данная поправка была внесена только 9 января 2026 года.

Таким образом, правовой статус SKAI определен с учетом особенностей пилотного характера проекта, добавляют в «Самрук-Казына».

На вопрос о юридической природе «права голоса» SKAI фонд отвечает через описание процедуры: участие ИИ в работе совета директоров не изменяет правовую природу решений, следовательно, ответственность за них в полном объеме несут члены совета директоров и соответствующие органы управления в пределах их компетенции. «Все решения СД принимаются коллегиально и фиксируются в протоколах заседаний», — отмечают в фонде.

В письме «Самрук-Казына» указывается, что SKAI может анализировать все вопросы, рассматриваемые СД. «В случае возникновения правовых вопросов или обращений со стороны уполномоченных органов фонд взаимодействует с ними в установленном законом порядке», — заключают в холдинге.

Закрытый контур

Изначально SKAI задумывалась как инструмент повышения прозрачности и качества корпоративного управления. Предполагалось, что нейросеть будет анализировать не только инвестиционные проекты, но и широкий массив внутренних и внешних нормативных документов, а также решения совета директоров, принятые с 2008 года, фактически за весь период существования «Самрук-Казына».

Фонд заявлял, что SKAI функционирует в закрытом контуре и развернута на одном из самых мощных вычислительных комплексов в стране — суперкомпьютере Al Farabium, принадлежащем портфельной компании фонда «Казахтелеком». За основу системы взята казахстанская языковая модель Alem LLM. «Таким образом, информация не покидает пределы страны, а высокая вычислительная мощность обеспечивает надежность и скорость анализа», — ранее обещали в «Самрук-Казына».

По данным холдинга на конец января 2026-го, SKAI приняла участие уже в шести заседаниях совета директоров, в ходе которых нейросеть работала по той же логике, что и другие участники. В частности, по каждому вопросу она формировала позицию в формате «за», «против» или «воздержался», после чего выдавала собственное аналитическое заключение. В «Самрук-Казына» утверждают, что на практике по большинству вопросов позиция SKAI совпадала с консолидированным решением совета, то есть нейросеть, как и остальные члены, голосовала «за».

История SKAI показывает, что вопрос об искусственном интеллекте в корпоративном управлении — это уже не просто PR-повестка, а зона юридической и институциональной неопределенности. Формально нейросеть анализирует, рекомендует, голосует «как все». Фактически же в систему принятия решений встроен участник, чья правовая природа до конца не определена.

Возможно, через несколько лет подобные модели станут стандартом уже с четко прописанными правилами, ответственностью и пределами полномочий. Но сегодня, получается, что SKAI — это пока эксперимент без инструкции.